Ben je klaar voor Copilot voor Microsoft 365?

15 januari 2024 heeft Microsoft bekendgemaakt dat Copilot voor Microsoft 365, de virtuele AI-assistent van Microsoft, beschikbaar is voor alle organisaties zonder minimale afname van 300 licenties. Dit is goed nieuws voor scholen. Daarom vertellen je meer over de mogelijkheden en voordelen, maar ook over de risico's van deze generatieve AI-tool.

Verschillende Copilots

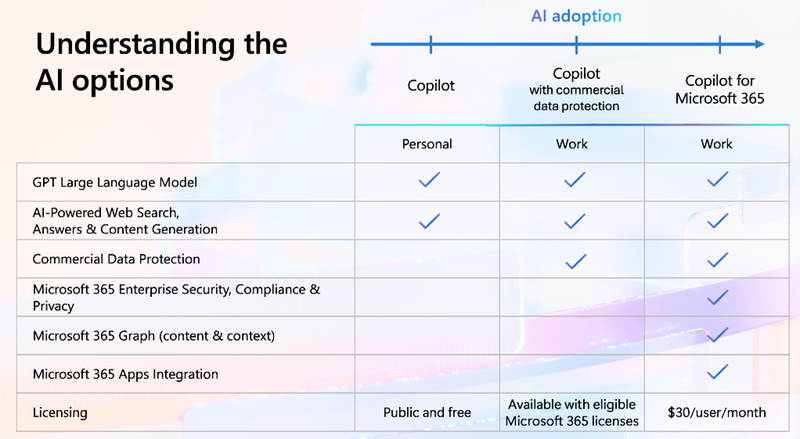

Microsoft heeft meerdere versies van Copilot op de markt gebracht met ieder een eigen benaming en set aan specificaties. Van een voor iedereen te gebruiken open Copilot tot een Copilot specifiek voor Microsoft 365. Zie hieronder in de tabel welke producten met welke functionaliteiten in het portfolio zitten tegen welke prijs:

*Let op, de prijs in euro’s kan afwijken

We gaan nu dieper in op Copilot voor Microsoft 365.

Wat is Copilot voor Microsoft 365?

Copilot voor Microsoft 365 is de generatieve AI-oplossing van Microsoft die is geïntegreerd in de Office 365-toepassingen, zoals Word, PowerPoint, Outlook, Excel en Teams. Het maakt gebruik van een combinatie van Large Language Models (LLM’s) die zijn getraind tot een geavanceerd model (GPT-4) om inhoud te begrijpen, samen te vatten, te voorspellen en te genereren. Microsoft maakt met Copilot generatieve AI mogelijk in de Office 365 toepassingen, zonder dat de data je eigen Microsoft-omgeving verlaat. Zo ontstaat er een nieuwe manier van werken met je eigen bedrijfsdata.

Generatieve AI op de werkplek

Uit onderzoek van Microsoft in de zakelijke markt blijkt dat 81% van de ‘early adopters’ minder tijd besteedt aan het zoeken naar informatie, 7% vindt dat hun vergaderingen efficiënter verlopen, 79% minder tijd kwijt is aan het verwerken van e-mail en 94% het makkelijker vindt om aan een eerste concept van een project te beginnen met Copilot voor Microsoft 365.

Een kanttekening die we bij deze uitkomsten willen plaatsen is dat de testen zijn uitgevoerd binnen het bedrijfsleven. Hier verschillen gebruiksscenario’s toch echt enorm van het onderwijs.

Bij SLBdiensten zien we dat de vraag naar Copilot vanuit het onderwijs nog beperkt is. Een aantal scholen hebben interesse getoond en een enkele school zou wel met een klein aantal gebruikers willen testen om te ervaren of er toegevoegde waarde is voor de organisatie.

Echter, uit al onze gesprekken met scholen van de afgelopen tijd zien wij ook dat er een heleboel randvoorwaarden nog niet op orde zijn. Zowel aan de zijde van de school als aan de kant van Microsoft. We noemen een drietal risico’s.

Risico 1. Data niet op orde

Als je met Copilot voor Microsoft 365 aan de slag gaat heeft dat een forse impact op hoe er omgegaan wordt met de data binnen de school. Het is niet zo dat Copilot data vindt die voorheen niet inzichtelijk was. Copilot legt vooral op een zeer duidelijke manier bloot dat veel data niet geclassificeerd is. Dat betekent zoveel als dat er te weinig beleid en regels rondom de data zijn met betrekking tot wie welke data mag zien, op welk moment, vanaf welke locatie of vanaf welk netwerk.

Data kan zomaar ‘overshared’ zijn; medewerkers hebben toegang tot data zonder dat het wellicht de bedoeling is. Het risico bestaat dat bedrijfsgevoelige of privacygevoelige informatie gevonden, gereproduceerd en verder gedeeld wordt. De wijze van toegang tot Microsoft 365, de bedrijfsdata en de beveiliging van deze aspecten verdienen daarom extra aandacht. De voorbeelden van salarisstroken die opeens inzichtelijk zijn, zijn bekend, maar je moet er toch ook niet aan denken dat gevoelige informatie zoals zorgdossiers opeens op een scherm verschijnen van iemand die daar niets mee te maken heeft.

Vanuit SLBdiensten zijn wij nu samen met SURF aan het kijken welke randvoorwaarden noodzakelijk zijn, welke verantwoordelijkheid Microsoft hier wellicht moet nemen en hoe wij scholen het beste kunnen adviseren richting het gebruik van Copilot voor Microsoft 365 en andere AI-toepassingen. Want laten we duidelijk zijn, de mogelijkheden zijn groot. De impact zal ook groot zijn, maar het is ook een technologie die niet meer te stoppen zal zijn. Maar, de informatiebeveiliging moet wel op orde zijn!

Risico 2. Data Protection Impact Assessment ontbreekt op dit moment

Een aanschaf van Copilot voor Microsoft 365 valt onder de aanbestede overeenkomst en daarmee onder de AVG-voorwaarden die gesteld zijn door SLM Rijk. Echter is er volgens de Rijksoverheid nog niet onderzocht of Copilot voor Microsoft 365 hier technisch aan voldoet.

En dat “op orde zijn” is op dit moment een grote uitdaging. De ontwikkelingen gaan op dit moment zo snel dat het bijna niet bij te houden is voor een school. Normaal gesproken gaan er wel wat stappen vooraf aan het in gebruik nemen van nieuwe diensten of oplossingen.

De ict-afdeling brengt behoeften van gebruikers en de organisatie in kaart, en vergelijkt verschillende leveranciers. Er volgt een inkooptraject, met onderhandelingen over prijs en voorwaarden. Tot slot neemt de school de software in gebruik. Als het nodig is, traint de organisatie medewerkers in het gebruik, of stelt regels voor de inzet van de software.

Risico 3. Schaduw-ict

Het risico dat er op dit moment is, is dat er een enorme hoeveelheid toepassingen op ons af komt met AI erin. Dit geldt voor zowel consumenten als onderwijsinstellingen. Maar helaas lopen die werelden meer en meer door elkaar heen. En dan kom je in de situatie terecht dat medewerkers soms besluiten om zelf AI-tools te gaan gebruiken. Gratis tools, niet getest, niet bekeken vanuit de AVG, wel handig en leuk voor in de les. Maar deze “schaduw-ict” kan een zeer groot risico vormen voor de organisatie.

Op internet zijn er veel gratis tools en diensten beschikbaar, die medewerkers voor uiteenlopende doelen in kunnen zetten. Vaak zit er onder deze gratis software alsnog een verdienmodel, dat lang niet altijd duidelijk is voor de gebruiker. Schaduw-ict komt in veel sectoren voor. Maar omdat leraren in het onderwijs veel autonomie hebben, kunnen ze relatief gemakkelijk gebruikmaken van schaduw-ict voor hun lessen.

Het gaat vaak om tools die veel functionaliteit bieden, maar waar de discussie over gebruiksvoorwaarden nog niet af is. Een onzorgvuldige omgang met persoonsgegevens ligt hierbij op de loer en daarmee dus ook overtreding van de regels rondom informatiebeveiliging en privacy. En voor je het weet heb je dan een datalek. Daarnaast zijn veel zaken rondom auteursrechten en AI op dit moment nog niet duidelijk. Zie ook een artikel vanuit Kennisnet hierover.

Terughoudendheid geboden bij gebruik Copilot voor Microsoft 365

Om bovenstaande redenen hebben wij vanuit SLBdiensten, samen met SURF en APS IT-diensten, besloten zeer terughoudend om te gaan met het aanbieden van Copilot voor Microsoft 365. Uiteraard zien wij ook veel mogelijkheden, maar op dit moment zijn er ook nog erg veel onduidelijkheden en zien wij ook een aantal zaken die wij voor het onderwijs nog niet voldoende geregeld vinden.

Onze specialist staat voor je klaar

Heb jij naar aanleiding van dit artikel nog vragen óf ben je benieuwd hoe SLBdiensten jouw onderwijsinstelling kan helpen bij vraagstukken rondom Copilot voor Microsoft 365? Neem dan contact op met onze specialist Ramon Zuidervaart.

Zie ook onze berichtgeving en advies over de beschikbaarheid van Copilot voor Microsoft 365.